机器视觉作为人工智能领域的重要分支,正逐步渗透到工业自动化、质量检测、自动驾驶等多个核心场景。要深入学习和应用机器视觉技术,掌握一款强大的开发平台是关键。苹果的Vision Pro框架(这里通常指基于苹果生态的计算机视觉框架,如Vision框架,或泛指如Halcon、OpenCV等专业视觉开发环境在专业设备上的部署)为开发者提供了强大的工具集。本文将引导您完成Vision Pro开发环境的安装,并概述其核心应用软件服务。

一、Vision Pro开发环境安装

1. 系统与硬件要求

在开始安装前,请确保您的开发设备满足基本要求。

- 操作系统:通常需要最新或特定版本的macOS(针对苹果Vision框架)或Windows/Linux(针对其他商业或开源视觉平台)。

- 硬件:建议配备性能较强的CPU、足够的内存(建议16GB以上)以及兼容的显卡(对于需要GPU加速的深度学习视觉任务尤为重要)。

- 开发工具:安装Xcode(苹果平台)或Visual Studio等IDE,并确保已安装相应的编译器和开发库。

2. 安装核心框架与SDK

- 苹果Vision框架:如果您在macOS上进行开发,Vision框架已集成在系统中。您只需通过Xcode新建项目,导入Vision库即可开始使用。确保Xcode为最新版本以获取最全的API支持。

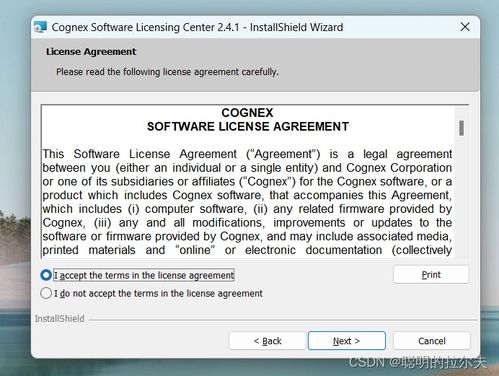

- 第三方机器视觉平台:如安装Halcon、OpenCV等。以OpenCV为例,可以通过官方网站下载预编译包,或使用包管理器(如Homebrew on macOS: brew install opencv)进行安装。安装后,需在您的开发环境中正确配置库路径和链接器设置。

- 依赖项管理:许多视觉任务依赖Python及科学计算库(如NumPy, SciPy)。建议使用Anaconda或虚拟环境(venv)来管理Python包,并通过pip安装opencv-python等必要组件。

3. 验证安装

创建一个简单的测试程序,例如使用Vision框架进行人脸检测,或使用OpenCV读取并显示一张图片,以确认所有组件已正确安装并运行。

二、核心应用软件服务概览

安装好开发环境后,Vision Pro提供的软件服务(以苹果Vision框架及扩展生态为例)可以支持多种高级视觉任务:

1. 图像分析与识别

- 目标检测与跟踪:提供高性能的API,用于在图像或视频流中实时检测和跟踪人脸、人体、文本或自定义对象。

- 图像分类:利用内置的机器学习模型或集成Core ML导入的自定义模型,对图像内容进行快速分类。

- 条形码/二维码识别:内置强大的检测器,可识别多种格式的条码,广泛应用于零售和物流。

2. 增强现实(AR)集成

Vision框架与ARKit深度集成,能够实现世界跟踪、场景理解和图像锚点检测,为开发沉浸式AR应用提供底层视觉能力。

3. 视觉与深度学习管道

- 自定义模型集成:支持通过Core ML将使用TensorFlow或PyTorch训练的视觉模型转换为iOS/macOS可用的格式,并利用Vision框架进行高效的图像预处理和结果后处理。

- 图像配准与比对:提供特征点检测和描述符计算,可用于图像匹配、全景图拼接等任务。

4. 视频处理服务

- 实时视频流分析:能够高效处理来自摄像头的视频帧,实现实时的视觉分析。

- 动作识别:结合其他传感器数据,可以分析视频中的动作序列。

三、入门实践建议

- 从官方示例开始:苹果开发者网站或OpenCV等社区提供了丰富的示例代码,是理解API用法的捷径。

- 分模块学习:不要试图一次性掌握所有功能。可以从图像I/O、基础转换开始,逐步深入到特征检测、目标识别等复杂任务。

- 结合项目实践:设定一个小目标,如开发一个文档扫描仪或简单的物品识别应用,在实践中巩固知识并解决问题。

###

成功安装Vision Pro开发环境并熟悉其核心服务,是开启机器视觉应用开发之旅的第一步。这个平台将复杂的底层算法封装为易用的API,让开发者能够更专注于解决具体的业务问题。随着技术的迭代,持续关注官方文档和开发者社区,将帮助您充分利用其强大功能,构建出智能、高效的视觉应用。